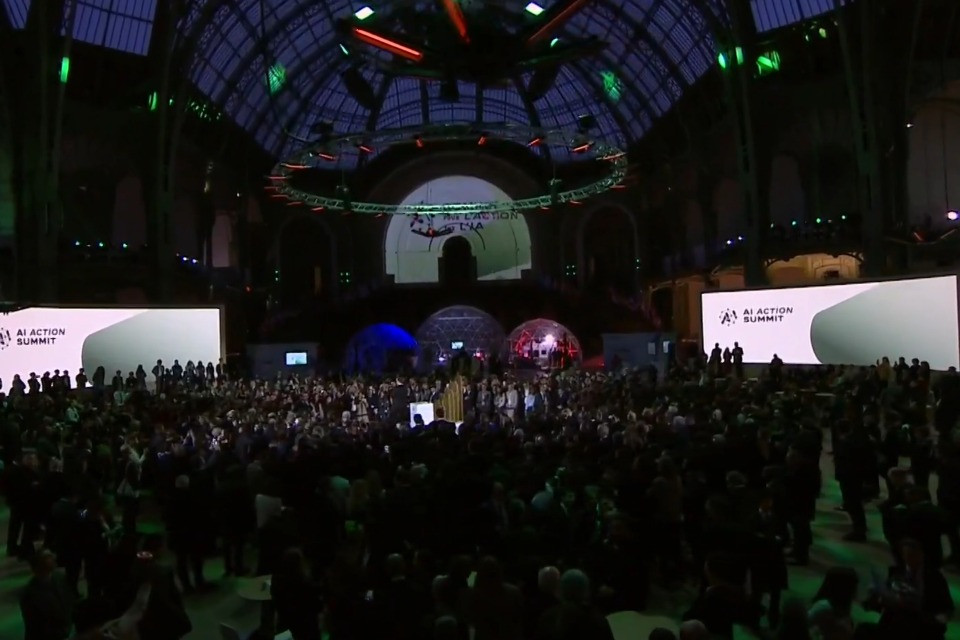

Tra oggi e domani, Parigi ospita il terzo vertice mondiale sull’intelligenza artificiale. Obiettivo del summit francese è fare in modo che a livello globale ci siano delle regole del gioco che permettano di contenere i possibili rischi dell'IA, concertando anche un quadro di sviluppo per una tecnologia che sta rivoluzionando ogni settore. Oltre ai politici (tra cui il vicepresidente Usa JD Vance), ci sarà tutto il gotha del settore, come il fondatore di OpenAI Sam Altman e rappresentanti di aziende quali Google, Nvidia o Anthropic.

"Interessi conflittuali"

La conferenza pone al centro il tema del disciplinamento dell'intelligenza artificiale. Mentre l'IA avanza, la regolamentazione ancora langue? "Ci sono diversi punti di vista", risponde Andrea Rizzoli, direttore dell'Istituto Dalle Molle sull'intelligenza artificiale. "Penso che il vicepresidente americano Vance sia a Parigi per dire che c'è troppa regolamentazione e che questa danneggia le aziende americane. Dall'altra parte, l'Europa ha deciso di intraprendere una via più cauta e secondo me ragionevole, con lo scopo di contenere e limitare gli abusi dell'IA. È chiaro che sono interessi conflittuali". Rizzoli però allo stesso tempo evidenzia "come per tutte le tecnologie, anche nel caso dell'intelligenza artificiale le sperimentazioni non possono essere totalmente incontrollate: sappiamo che ci possono essere effetti indesiderati e siccome nessuno capisce davvero come funzionino questi sistemi, potrebbe essere pericoloso metterli sotto il controllo di sistemi critici, così come concedere loro troppe libertà".

Derive belliche

Cosa immaginare dunque per regolamentare l'intelligenza artificiale? Forse un'agenzia internazionale? Il direttore dell'Istituto Dalle Molle non si sbilancia troppo, ma considera "ragionevole avere una specie di punto di incontro in cui gli sviluppatori, le aziende e le università discutano delle potenziali conseguenze. Io ricordo che il nostro direttore scientifico, già 5 o 6 anni fa, aveva firmato una lettera all'ONU nella quale si chiedeva di proibire l'uso dell'IA per scopi militari e bellici. In questi settori, oggi gli algoritmi dell'IA sono più che utilizzati".

L'efficacia di questi incontri

I grandi incontri internazionali spesso faticano a tradursi in cambiamenti tangibili. Il timore che anche questo vertice parigino finisca per essere un flop è reale. "Ci sono già molte critiche", osserva Rizzoli. "È stata rilasciata una bozza delle dichiarazioni che saranno pubblicate alla fine del summit e molti sono delusi dal fatto che non si menzionino i rischi potenziali dell'IA". Secondo Rizzoli, tuttavia, parlare di "fiasco" è ancora prematuro. "Tutti questi summit, come anche quelli sul cambiamento climatico, sono sicuramente delle grandi passerelle politiche, ma sono anche momenti importanti, perché politici e tecnici si incontrano e si scambiano idee. Da qui, possono quindi anche scaturire delle azioni. Staremo a vedere quanto saranno concrete".

E l'Europa?

Negli ultimi mesi e ancora negli scorsi giorni, la geografia delle notizie relative all'IA è stata essenzialmente limitata a Stati Uniti e Cina. Mentre Washington e Pechino innovano, sembrerebbe che l'Europa si limiti a regolamentare. "Sì e no", sfuma Andrea Rizzoli. "Io vedo numerose applicazioni di intelligenza artificiale con un taglio soprattutto tecnico che vengono sviluppate in Europa e anche in Svizzera. Credo inoltre che ora che si possono realizzare delle applicazioni usando modelli più leggeri, ci sarà uno sviluppo ancora più veloce e diffuso a livello mondiale, non limitato quindi alla sola Cina. È una mia speranza, ma penso che ci siano delle buone possibilità".